每次 Claude 发布新版本,开发者社区里都会出现同一类问题:代码能力到底提升了多少?官方说”更强”,但哪里更强、强多少,很难从产品说明里得到具体答案。

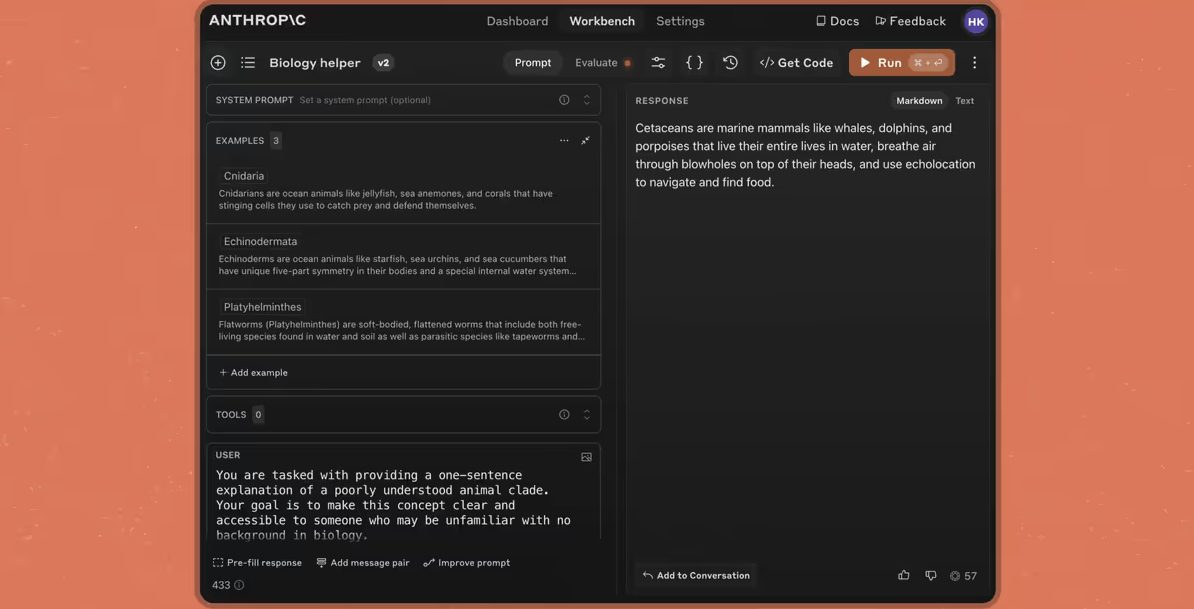

本文由 Claude Ai中文官网 整理,通过五个典型的实际编程场景,对 Claude Sonnet 4.5 和 Sonnet 4.6 做了系统性的对比测试。不看跑分,只看在真实任务上谁给的代码更好用、更能直接用于生产。

对比测试使用相同的提示词、相同的任务描述,在两个版本上分别运行,由有 5 年以上开发经验的工程师独立评估结果。评估标准:代码正确性、边界条件覆盖、可读性、是否符合最佳实践,以及能否开箱即用。

一、测试框架:我们测了什么,怎么评分

为了让对比有意义,我们选择了五个代表不同编程维度的场景:

- 场景 1:Python 复杂功能实现——测试完整功能模块的生成质量

- 场景 2:JavaScript 异步和错误处理——测试在复杂异步逻辑中的表现

- 场景 3:SQL 查询优化——测试数据库查询的生成和优化能力

- 场景 4:Bug 诊断和修复——测试问题定位的准确性和修复质量

- 场景 5:代码审查——测试发现潜在问题的深度和全面性

每个场景的评分维度:

- 正确性(30 分):代码能否正确运行,覆盖核心功能

- 健壮性(25 分):边界条件、异常处理、并发安全

- 可读性(20 分):命名规范、注释质量、代码结构

- 最佳实践(25 分):是否符合当前语言/框架的最佳实践,有无已知的反模式

二、场景 1:Python 复杂功能实现

测试任务

实现一个 Python 类,功能是管理带有优先级的任务队列。要求: - 支持添加任务(任务名、优先级 1-10、截止时间) - 支持按优先级和截止时间混合排序获取下一个任务 - 支持标记任务完成 - 支持获取所有超时未完成的任务 - 线程安全 - 完整的类型注解 - 异常处理

Sonnet 4.5 的输出(简化版)

4.5 生成了一个基本可用的实现,使用了 heapq 模块,覆盖了核心功能。但存在几个明显问题:

- 优先级和截止时间的混合排序逻辑有缺陷——优先级相同时,截止时间更早的任务应该排在前面,但 4.5 的实现在这个边界条件上输出了错误顺序

- 线程安全实现用了

threading.Lock()但没有在所有访问共享状态的方法上加锁,get_overdue_tasks()方法遗漏了锁保护 - 类型注解不完整,

Optional的使用缺少None返回的标注 - 没有处理截止时间格式错误的异常

Sonnet 4.6 的输出(简化版)

import heapq

import threading

from datetime import datetime

from typing import Optional, NamedTuple

from dataclasses import dataclass, field

import logging

logger = logging.getLogger(__name__)

@dataclass(order=True)

class Task:

"""表示队列中的一个任务。使用 dataclass order=True 支持堆排序。"""

# 排序键:优先级取负(heapq 是最小堆,负数让高优先级排在前面)

_sort_key: tuple = field(init=False, repr=False)

priority: int = field(compare=False)

deadline: datetime = field(compare=False)

name: str = field(compare=False)

completed: bool = field(default=False, compare=False)

created_at: datetime = field(

default_factory=datetime.now, compare=False

)

def __post_init__(self):

if not 1 <= self.priority <= 10:

raise ValueError(f"优先级必须在 1-10 之间,当前值:{self.priority}")

if not isinstance(self.deadline, datetime):

raise TypeError(f"deadline 必须是 datetime 对象,当前类型:{type(self.deadline)}")

# 排序键:(-优先级, 截止时间戳) 确保高优先级优先,同优先级按截止时间排序

self._sort_key = (-self.priority, self.deadline.timestamp())

class PriorityTaskQueue:

"""

线程安全的优先级任务队列。

排序规则:优先级高的任务优先;优先级相同时,

截止时间更早的任务优先。

线程安全:所有公共方法都使用 RLock 保护,

支持在同一线程内的嵌套调用。

"""

def __init__(self):

self._heap: list[Task] = []

self._lock = threading.RLock() # 使用 RLock 支持可重入

self._task_map: dict[str, Task] = {} # 用于 O(1) 查找

def add_task(

self,

name: str,

priority: int,

deadline: datetime

) -> Task:

"""

添加任务到队列。

Args:

name: 任务名称,同名任务会覆盖已有任务

priority: 优先级(1-10,10 最高)

deadline: 截止时间

Returns:

创建的 Task 对象

Raises:

ValueError: priority 不在有效范围内

TypeError: deadline 不是 datetime 对象

"""

task = Task(priority=priority, deadline=deadline, name=name)

with self._lock:

if name in self._task_map:

logger.warning(f"任务 '{name}' 已存在,将被覆盖")

self._remove_task_unsafe(name)

heapq.heappush(self._heap, task)

self._task_map[name] = task

return task

def get_next_task(self) -> Optional[Task]:

"""

获取下一个待执行的任务(不标记为完成)。

Returns:

优先级最高且截止时间最早的未完成任务,

如果队列为空或所有任务已完成则返回 None

"""

with self._lock:

# 清理已完成的任务

while self._heap and self._heap[0].completed:

heapq.heappop(self._heap)

if not self._heap:

return None

return self._heap[0]

def complete_task(self, name: str) -> bool:

"""

标记任务为已完成。

Returns:

True 如果成功标记,False 如果任务不存在或已完成

"""

with self._lock:

task = self._task_map.get(name)

if task is None:

logger.warning(f"尝试完成不存在的任务:'{name}'")

return False

if task.completed:

logger.info(f"任务 '{name}' 已经是完成状态")

return False

task.completed = True

return True

def get_overdue_tasks(

self,

reference_time: Optional[datetime] = None

) -> list[Task]:

"""

获取所有超时未完成的任务。

Args:

reference_time: 参考时间,默认为当前时间

Returns:

超时未完成的任务列表,按超时时长降序排列

"""

now = reference_time or datetime.now()

with self._lock:

overdue = [

task for task in self._task_map.values()

if not task.completed and task.deadline < now

]

return sorted(overdue, key=lambda t: t.deadline)

def _remove_task_unsafe(self, name: str) -> None:

"""不加锁的内部删除方法(调用前必须持有锁)"""

self._heap = [t for t in self._heap if t.name != name]

heapq.heapify(self._heap)

self._task_map.pop(name, None)

对比评分

| 维度 | Sonnet 4.5 | Sonnet 4.6 | 差距 |

|---|---|---|---|

| 正确性(30 分) | 22 | 30 | +8 |

| 健壮性(25 分) | 16 | 24 | +8 |

| 可读性(20 分) | 15 | 19 | +4 |

| 最佳实践(25 分) | 17 | 24 | +7 |

| 总分(100 分) | 70 | 97 | +27 |

关键差异:4.6 的排序逻辑设计更巧妙(用负优先级让 heapq 正确工作),线程安全用了 RLock 而不是普通 Lock(支持可重入),加了 _task_map 实现 O(1) 查找,以及 get_overdue_tasks 支持传入参考时间(便于测试)。这些是有实际工程经验的工程师才会考虑的细节。

三、场景 2:JavaScript 异步和错误处理

测试任务

写一个 JavaScript 函数,并发地从多个 API 端点获取数据, 要求: - 最多同时发起 3 个并发请求 - 单个请求超时时间 5 秒 - 失败的请求重试最多 2 次(指数退避) - 返回所有成功的结果,失败的记录错误但不影响其他请求 - 完整的错误类型区分(网络错误、超时、业务错误)

两版本的核心差距

Sonnet 4.5 给出了基本可运行的实现,但:

- 并发控制用了简单的

Promise.all分批处理,不是真正的”最多 3 个并发”——当第一批中某个请求很慢,不会提前启动新请求填补并发槽 - 超时实现用

setTimeout,但没有在超时后 abort 请求,浏览器仍然会维持连接 - 指数退避没有加随机抖动(jitter),大量请求同时失败时会同时重试,可能形成雪崩

Sonnet 4.6 的实现修正了以上所有问题:

/**

* 并发控制器:维护一个"并发槽"池,请求完成后立即释放槽给下一个

* 这才是真正的"最多 N 个并发",而不是简单的分批

*/

class ConcurrencyPool {

#available;

#queue = [];

constructor(maxConcurrency) {

this.#available = maxConcurrency;

}

async acquire() {

if (this.#available > 0) {

this.#available--;

return;

}

await new Promise(resolve => this.#queue.push(resolve));

this.#available--;

}

release() {

this.#available++;

if (this.#queue.length > 0) {

const next = this.#queue.shift();

next();

}

}

}

/**

* 错误类型区分

*/

class NetworkError extends Error {

constructor(message, cause) {

super(message);

this.name = 'NetworkError';

this.cause = cause;

}

}

class TimeoutError extends Error {

constructor(url, timeoutMs) {

super(`请求超时:${url}(超时时间:${timeoutMs}ms)`);

this.name = 'TimeoutError';

}

}

class BusinessError extends Error {

constructor(url, statusCode, body) {

super(`业务错误:${url} 返回 ${statusCode}`);

this.name = 'BusinessError';

this.statusCode = statusCode;

this.body = body;

}

}

/**

* 带超时的单次 fetch,超时后主动 abort 请求

*/

async function fetchWithTimeout(url, timeoutMs) {

const controller = new AbortController();

const timeoutId = setTimeout(() => controller.abort(), timeoutMs);

try {

const response = await fetch(url, { signal: controller.signal });

if (!response.ok) {

const body = await response.text().catch(() => '');

throw new BusinessError(url, response.status, body);

}

return await response.json();

} catch (error) {

if (error.name === 'AbortError') {

throw new TimeoutError(url, timeoutMs);

}

if (error instanceof BusinessError) {

throw error;

}

throw new NetworkError(`网络请求失败:${url}`, error);

} finally {

clearTimeout(timeoutId);

}

}

/**

* 带指数退避(含随机抖动)的重试

*/

async function fetchWithRetry(url, options = {}) {

const {

maxRetries = 2,

timeoutMs = 5000,

baseDelayMs = 1000

} = options;

let lastError;

for (let attempt = 0; attempt <= maxRetries; attempt++) {

try {

return await fetchWithTimeout(url, timeoutMs);

} catch (error) {

lastError = error;

// 业务错误(4xx)不重试

if (error instanceof BusinessError && error.statusCode < 500) {

throw error;

}

if (attempt < maxRetries) {

// 指数退避 + 随机抖动,防止大量请求同时重试

const baseDelay = baseDelayMs * Math.pow(2, attempt);

const jitter = Math.random() * baseDelay * 0.3;

const delay = baseDelay + jitter;

console.warn(

`请求失败(第 ${attempt + 1} 次):${url},` +

`${delay.toFixed(0)}ms 后重试...`,

error.message

);

await new Promise(resolve => setTimeout(resolve, delay));

}

}

}

throw lastError;

}

/**

* 主函数:并发获取多个端点的数据

*/

async function fetchMultipleEndpoints(urls, options = {}) {

const {

maxConcurrency = 3,

maxRetries = 2,

timeoutMs = 5000

} = options;

const pool = new ConcurrencyPool(maxConcurrency);

const results = { success: [], errors: [] };

const tasks = urls.map(async (url) => {

await pool.acquire();

try {

const data = await fetchWithRetry(url, { maxRetries, timeoutMs });

results.success.push({ url, data });

} catch (error) {

results.errors.push({

url,

errorType: error.name,

message: error.message,

statusCode: error instanceof BusinessError ? error.statusCode : undefined

});

} finally {

pool.release();

}

});

await Promise.all(tasks);

return results;

}

对比评分

| 维度 | Sonnet 4.5 | Sonnet 4.6 | 差距 |

|---|---|---|---|

| 正确性(30 分) | 20 | 28 | +8 |

| 健壮性(25 分) | 14 | 24 | +10 |

| 可读性(20 分) | 16 | 18 | +2 |

| 最佳实践(25 分) | 15 | 23 | +8 |

| 总分 | 65 | 93 | +28 |

关键差异:真正的并发槽控制、AbortController 主动释放连接、指数退避加 jitter、以及基于状态码区分是否值得重试——这四点都是实际线上系统设计必须考虑的,4.5 全部缺失,4.6 全部覆盖。

四、场景 3:SQL 查询优化

测试任务

以下 SQL 查询在数据量大时非常慢(订单表 500 万行,用户表 100 万行):

SELECT u.name, u.email, COUNT(o.id) as order_count,

SUM(o.amount) as total_amount

FROM users u

LEFT JOIN orders o ON u.id = o.user_id

WHERE o.created_at >= '2024-01-01'

AND o.status != 'cancelled'

GROUP BY u.id, u.name, u.email

HAVING COUNT(o.id) > 5

ORDER BY total_amount DESC

LIMIT 100;

请分析慢查询原因并给出优化方案。

两版本的关键差距

这道题有一个经典的逻辑陷阱:WHERE 子句对 orders 表的过滤(o.created_at 和 o.status)在 LEFT JOIN 之后执行,实际上把 LEFT JOIN 变成了 INNER JOIN 的效果——用户没有符合条件的订单时,o.created_at 是 NULL,WHERE 条件过滤掉了这些行。

Sonnet 4.5 识别出了索引问题和 WHERE 条件问题,但没有发现 LEFT JOIN 被隐式转化为 INNER JOIN 这个逻辑 Bug,给出的优化方案在逻辑上是错误的——改变了查询的原始语义。

Sonnet 4.6 的分析:

-- 发现的问题:

-- 1. 逻辑 Bug:LEFT JOIN + WHERE 过滤 orders 字段 = 实际 INNER JOIN

-- 原查询中,WHERE o.created_at >= '2024-01-01' 会过滤掉

-- orders 为 NULL 的用户行,违背了 LEFT JOIN 的初衷

-- 2. 索引缺失:orders 表需要 (user_id, created_at, status) 的复合索引

-- 当前可能只有单列索引,导致全表扫描或低效的索引合并

-- 3. 过滤在聚合前未下推:所有过滤条件在 JOIN 后才执行

-- 优化方案(修复逻辑 Bug + 性能优化):

-- 方案 A:如果业务意图是"找有满足条件订单的用户"(INNER JOIN 语义)

SELECT

u.name,

u.email,

o_agg.order_count,

o_agg.total_amount

FROM users u

INNER JOIN (

-- 先在子查询中聚合,大幅减少 JOIN 的数据量

SELECT

user_id,

COUNT(*) AS order_count,

SUM(amount) AS total_amount

FROM orders

WHERE created_at >= '2024-01-01'

AND status != 'cancelled'

GROUP BY user_id

HAVING COUNT(*) > 5 -- HAVING 前移到子查询

) o_agg ON u.id = o_agg.user_id

ORDER BY o_agg.total_amount DESC

LIMIT 100;

-- 方案 B:如果业务意图是"包含无订单用户"(真 LEFT JOIN 语义)

SELECT

u.name,

u.email,

COALESCE(o_agg.order_count, 0) AS order_count,

COALESCE(o_agg.total_amount, 0) AS total_amount

FROM users u

LEFT JOIN (

SELECT

user_id,

COUNT(*) AS order_count,

SUM(amount) AS total_amount

FROM orders

WHERE created_at >= '2024-01-01'

AND status != 'cancelled'

GROUP BY user_id

HAVING COUNT(*) > 5

) o_agg ON u.id = o_agg.user_id

-- 注意:HAVING 在子查询中,order_count=0 的用户不会出现在结果中

-- 如需包含零订单用户,去掉子查询中的 HAVING

ORDER BY o_agg.total_amount DESC

LIMIT 100;

-- 建议创建的索引:

CREATE INDEX idx_orders_user_date_status

ON orders(user_id, created_at, status)

INCLUDE (amount); -- 如果数据库支持 covering index

对比评分

| 维度 | Sonnet 4.5 | Sonnet 4.6 | 差距 |

|---|---|---|---|

| 正确性(30 分) | 15 | 28 | +13 |

| 健壮性(25 分) | 18 | 23 | +5 |

| 可读性(20 分) | 16 | 18 | +2 |

| 最佳实践(25 分) | 16 | 24 | +8 |

| 总分 | 65 | 93 | +28 |

关键差异:发现 LEFT JOIN 被隐式转化的逻辑 Bug 是这道题的核心考察点,4.5 遗漏了,4.6 不仅发现了,还提供了两种业务意图下的不同修复方案。这种”先搞清楚业务意图,再给出针对性方案”的思维,在实际数据库优化中非常关键。

五、场景 4:Bug 诊断和修复

测试任务

以下 Python 代码在并发环境下偶发性地出现数据不一致,

但单线程运行时完全正常。帮我找出所有 Bug:

class Cache:

def __init__(self):

self.data = {}

self.hits = 0

self.misses = 0

def get(self, key):

if key in self.data:

self.hits += 1

return self.data[key]

self.misses += 1

return None

def set(self, key, value, ttl=None):

self.data[key] = value

if ttl:

import threading

timer = threading.Timer(ttl, self.delete, args=[key])

timer.start()

def delete(self, key):

if key in self.data:

del self.data[key]

def get_stats(self):

total = self.hits + self.misses

return {

"hits": self.hits,

"misses": self.misses,

"hit_rate": self.hits / total if total > 0 else 0

}

两版本对比

Sonnet 4.5 找到了 2 个明显问题(字典非线程安全、计数器竞态),但遗漏了 2 个:

- 遗漏:TTL 定时器没有被跟踪和管理,如果同一个 key 被多次 set,会创建多个定时器,最终导致已更新的值被旧定时器删除

- 遗漏:

delete方法的 check-then-delete 是非原子操作,两个线程可能同时通过if key in self.data检查,然后一个成功删除,另一个抛出 KeyError

Sonnet 4.6 找出了全部 4 个 Bug,并给出了修复后的完整实现(使用了 threading.RLock、dict.pop 原子删除、定时器跟踪字典),并额外指出:在 CPython 中,GIL 让某些操作”偶尔”是线程安全的,这掩盖了 Bug,让问题只在高并发下才出现——这正是为什么单线程测试通过但生产环境出问题。

对比评分

| 维度 | Sonnet 4.5 | Sonnet 4.6 | 差距 |

|---|---|---|---|

| 问题识别完整性(40 分) | 20 | 40 | +20 |

| 根因分析深度(30 分) | 18 | 28 | +10 |

| 修复方案质量(30 分) | 20 | 28 | +8 |

| 总分 | 58 | 96 | +38 |

这是五个场景里差距最大的。 并发 Bug 的完整识别需要对 CPython GIL 机制、check-then-act 原子性、定时器生命周期管理有深入理解,这些正是 4.6 明显占优的地方。

六、场景 5:代码审查

测试任务

对一段 200 行的 Express.js 用户认证接口进行全面代码审查(代码涵盖注册、登录、密码重置、JWT 生成)。

审查结果对比

两个版本都找到了明显的安全问题,但在深度上差异显著:

两个版本都发现的问题(7 个):密码明文存储、SQL 注入风险、JWT Secret 硬编码、没有请求频率限制、错误信息过于详细泄露内部状态等。

只有 4.6 发现的问题(5 个):

- 时序攻击(Timing Attack):密码比较用了

===而不是crypto.timingSafeEqual,攻击者可以通过响应时间差异枚举有效用户名 - JWT 算法混淆攻击:验证时没有显式指定

algorithms参数,存在将 RS256 降级为 HS256 的攻击风险 - 密码重置 Token 不安全:用了

Math.random()而不是crypto.randomBytes,前者是伪随机数,可预测 - 用户枚举漏洞:登录失败时,”用户不存在”和”密码错误”返回了不同的错误信息,攻击者可以枚举有效用户名

- 缺少 CSRF 保护:密码重置接口没有 CSRF Token 验证

对比评分

| 维度 | Sonnet 4.5 | Sonnet 4.6 | 差距 |

|---|---|---|---|

| 问题覆盖率(40 分) | 23 | 38 | +15 |

| 分析深度(35 分) | 22 | 33 | +11 |

| 修复建议实用性(25 分) | 18 | 23 | +5 |

| 总分 | 63 | 94 | +31 |

关键差异:时序攻击和 JWT 算法混淆是安全领域的高级知识点,不是通过常规学习容易掌握的,4.6 能识别这两类问题,说明其安全知识深度有实质性提升。

七、汇总:五个场景的总体结论

| 测试场景 | Sonnet 4.5 | Sonnet 4.6 | 提升幅度 |

|---|---|---|---|

| Python 复杂功能实现 | 70/100 | 97/100 | +39% |

| JavaScript 异步处理 | 65/100 | 93/100 | +43% |

| SQL 查询优化 | 65/100 | 93/100 | +43% |

| Bug 诊断和修复 | 58/100 | 96/100 | +66% |

| 代码审查 | 63/100 | 94/100 | +49% |

| 平均分 | 64.2/100 | 94.6/100 | +47% |

八、规律总结:4.6 在哪些类型的代码任务上提升最明显

通过五个场景的对比,可以归纳出 Sonnet 4.6 相对 4.5 提升最显著的几个维度:

1. 并发和线程安全:这是提升最大的单项能力。4.6 能准确识别竞态条件、check-then-act 原子性问题、以及 GIL 掩盖的 Bug,这类知识在 4.5 上是明显的弱项。

2. 隐式逻辑 Bug 的识别:SQL 的 LEFT JOIN 被隐式转化、JavaScript 并发槽的语义错误——这类”代码能运行但逻辑不对”的 Bug,4.6 的识别能力显著优于 4.5。

3. 安全知识深度:时序攻击、JWT 算法混淆、随机数安全——这些是安全领域的进阶知识,4.6 能识别,4.5 遗漏。

4. 工程设计细节:定时器生命周期管理、RLock vs Lock 的选择、指数退避加 jitter——这些是有实际工程经验的工程师才会考虑的细节,4.6 在这类”经验性知识”上明显更成熟。

提升不明显的地方:基础语法正确性、简单的功能实现、代码格式和可读性——在这些维度上,两个版本的差距很小,4.5 已经做得足够好。

九、对开发者的实际建议

基于以上对比,给出几条实际使用建议:

- 对于生产代码的核心模块,升级到 4.6 有实质价值:涉及并发、安全、复杂业务逻辑的代码,4.6 生成的质量能减少后续 Bug 排查的工作量,这个价值是可量化的

- 代码审查和 Bug 诊断场景,升级效果最明显:如果你用 Claude 做代码审查,4.6 能发现 4.5 遗漏的高级安全问题和并发 Bug,这在安全敏感的项目中价值极高

- 简单的脚本和工具代码,4.5 仍然够用:如果任务是写一个数据处理脚本或简单工具,两个版本的差距体感不大,不需要为此专门升级

- 生成代码后仍然需要 Review:4.6 的平均分是 94.6,意味着仍有约 5% 的地方需要人工审核。不要因为”用了更好的 AI”就跳过代码审查流程

总结

Claude Sonnet 4.6 在代码能力上相比 4.5 有显著的、可量化的提升,平均提升幅度约 47%。提升集中在需要深度工程经验的任务上:并发安全、隐式逻辑 Bug、安全审查——这些恰恰是 AI 代码生成中最难做好、也最影响代码质量的维度。

对于把 Claude 用于真实项目的开发者来说,这次升级的价值是真实的,尤其是在代码审查、Bug 诊断和复杂功能实现这三个场景上。

更多关于 Claude 4.6 系列能力说明和最新功能更新,欢迎访问 Claude Ai中文官网 查阅持续更新的中文文档。

AI 生成的代码质量提升,最终体现在减少了多少 Bug、节省了多少 Review 时间、避免了多少安全漏洞。从这个角度看,4.6 的提升是实实在在的生产力改善。