📌 内容摘要

- 这篇不是教程,是真实的踩坑记录——从”把 Claude 当万能工具”到”找到真正适合内部工具的用法”的完整过程。

- 七个最高频的坑:需求不清、Prompt 太随意、忘记权限边界、没有反馈机制、过度自动化、忽略内容安全、推广方式错误。

- 每个坑都有具体的”当时怎么想的 → 出了什么问题 → 最后怎么解决”,不说废话。

- 文末给出一套可复用的内部工具上线检查清单,新项目对照着来能少走很多弯路。

背景:我们为什么要做这个工具

这件事的起点很普通:公司有大量重复性的文字工作——周报整理、会议纪要、竞品分析摘要、客户邮件回复。每个人每周花在这上面的时间加起来相当可观,而且这些工作本质上是”格式化已有信息”,不需要太多创造力。

于是我们决定用 Claude 搭一个内部工具,把这些任务自动化或半自动化。听起来很合理,结果踩了一路的坑。

以下是完整的踩坑记录,按时间顺序排列。写这篇的目的不是炫耀”我们做了什么”,而是希望你们在做类似事情的时候,这些坑能跳过去。

坑一:需求没想清楚就开始做

当时怎么想的:AI 工具嘛,先做起来再说,反正改起来快。

出了什么问题:做到一半发现不同部门对”同一个功能”的期望完全不同。市场部要的周报摘要是”给老板看的执行摘要”,销售部要的是”给客户看的进展更新”,运营部要的是”给自己团队做记录的详细版本”。我们一开始做了一个通用的”周报整理”功能,结果三个部门都说”不太对”,但说不清哪里不对。

最后怎么解决:回退一步,用半天时间做了一个简单的用户访谈——每个主要使用场景找2-3个人,问三个问题:你现在怎么做这件事、最耗时的环节是哪里、你期望工具帮你做到什么程度(替你做还是帮你做)。访谈结果差异大到超出我们预期,于是按场景拆分成了三个独立的功能模块,每个模块只服务一类需求。

在动手之前,先写一段”这个工具是给谁用的、帮他们做什么、不做什么”,然后找3个潜在用户确认。”不做什么”和”做什么”一样重要——明确边界能避免做出一个四不像的通用工具。

坑二:Prompt 写得太随意

当时怎么想的:Claude 很聪明,稍微提示一下就能做好。

出了什么问题:早期的 Prompt 大概是这样的——”帮我把以下会议记录整理成摘要”。结果10个人用,输出风格差异极大:有的500字,有的50字;有的有结构,有的是流水账;有的用中文,有的自动切成中英混杂。用户开始抱怨说”每次出来的结果都不一样,不知道期望什么”。

最后怎么解决:把 Prompt 当产品设计来做,而不是随手写几句话。具体改进了三点:

第一,明确输出格式。不说”整理成摘要”,而是说”输出以下结构:决策事项(列表)、待办事项(列表,含负责人和截止日期)、下次会议确认事项(列表)。每个部分不超过5条”。

第二,给示例输出。在 Prompt 里加一段”参考以下格式”加上一个实际的好例子。这个改动让输出一致性提升最明显。

第三,建立内部的 Prompt 版本管理。用一个简单的文档记录每次改动、改动原因、改后效果,方便后续优化和回滚。

Prompt 越详细,输出越稳定——但超过某个程度后,太长的 Prompt 反而让 Claude 抓不住重点。我们最终把核心 Prompt 控制在150-300字,格式要求单独放在最后,效果比500字的”面面俱到版”更好。

坑三:忘记了权限和信息边界

当时怎么想的:内部工具嘛,安全问题等以后再说。

出了什么问题:有个功能是”帮你写给客户的邮件”。一个销售同事把客户的详细报价单(含内部折扣和成本信息)粘贴进去,让 Claude 帮写跟进邮件。Claude 写的邮件里顺手提到了内部折扣比例,差点被发给客户。还有一次,HR 用工具处理了员工薪资数据,数据留在了工具的对话历史里,被另一个有工具访问权限的同事看到了。

最后怎么解决:做了三件事。一是在每个功能入口加了一段使用说明,明确写”请不要粘贴以下类型的信息:客户报价、员工薪资、合同条款、尚未公开的产品信息”。二是对话历史默认不留存,每次使用完建议用户手动清除。三是对处理敏感信息的功能(如 HR 工具)做了单独的访问权限控制,不是所有人都能用。

更重要的是:我们建立了一个”这个信息适不适合喂给 AI”的判断框架,并培训了所有用户——不是让大家不用,而是让大家知道哪些可以用、哪些要脱敏后再用。

坑四:没有收集反馈的机制

当时怎么想的:工具上线了,有问题大家会来说的。

出了什么问题:上线两周后,主动来反馈问题的人几乎为零。但当我们主动去问的时候,发现有几个人已经悄悄停用了,原因是”有时候出来的东西还需要大改,我自己写反而更快”。这个问题我们完全不知道,因为没有人来说,而我们也没有看。

最后怎么解决:在每个功能的输出下面加了一个极简的反馈按钮——只有三个选项:👍 能直接用 / 🔧 需要修改 / 👎 要重写。数据表明”需要修改”的比例高达40%,这个数字让我们意识到 Prompt 还远没有到位。我们按功能统计了差评率,优先优化差评率最高的功能,两个迭代周期后整体满意度明显上升。

另外,每两周做一次快速的”5分钟问卷”,只问三个问题:上周用了几次、最有用的功能是什么、最想改进的是什么。问题简单,回复率高,信息质量比长篇调研高很多。

坑五:过度自动化,去掉了人的判断

当时怎么想的:既然 AI 能做,就让它全做,减少人工干预。

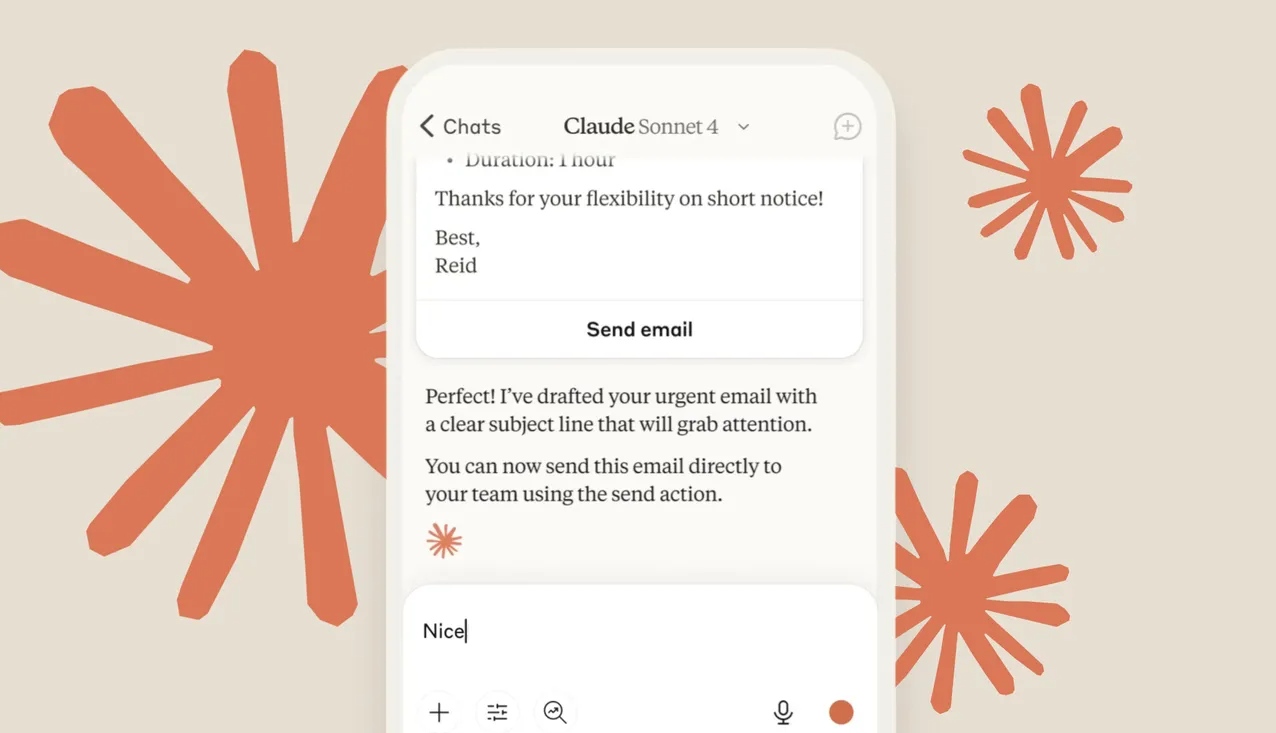

出了什么问题:有个功能是”自动生成并发送周报邮件”——用户填入本周的工作内容,AI 生成邮件,直接发送。结果有几封邮件出了问题:一封把数字写错了(原文说”增长了30%”,AI 生成时写成了”增长了300%”);一封语气明显和当事人平时不一样,收件人觉得奇怪专门来问;还有一封把正在谈判中的项目描述得过于乐观,让接收方产生了错误预期。

最后怎么解决:把”自动发送”改成了”生成草稿,人工审核后发送”。虽然多了一步操作,但这一步实际上很快(看一眼确认没问题),却能避免上述问题。我们后来总结出一个原则:凡是需要对外发送的内容(邮件、报告、通知),一定保留人工审核的环节;内部草稿和辅助分析可以直接用。 这个原则现在是我们所有 AI 工具的默认设计规范。

坑六:Prompt 的维护没有人负责

当时怎么想的:Prompt 写好一次就行了,以后不用怎么改。

出了什么问题:工具上线三个月后,有人发现某个功能的输出质量莫名其妙变差了。排查后发现,有人”顺手”改了一下 Prompt,觉得自己改得更好,但没有告诉其他人,也没有测试。而且没有版本记录,根本不知道原来的 Prompt 是什么。与此同时,随着公司业务变化,有些功能的使用场景也变了,但没有人同步更新 Prompt,导致输出越来越跟实际需求脱节。

最后怎么解决:指定了一个”AI 工具负责人”(不一定是全职,可以是兼职),负责维护 Prompt 版本、收集反馈、定期优化。Prompt 存在一个共享文档里,每次修改要注明”改了什么、为什么改、改后测试了哪些案例”。改动需要至少一个测试用例验证效果,不能随意修改。听起来有点麻烦,但一旦出问题,这些记录是定位问题的唯一手段。

坑七:推广方式错了

当时怎么想的:工具做好了发个全员通知,大家就会来用。

出了什么问题:发了全员通知,当天有一批人试用,然后大部分人再也没来。问了一下原因,主要有两类:一类是”试了一下感觉还行,但我现在的方式也能用,懒得改习惯”;另一类是”不太会用,不知道用在哪、怎么用才能省时间”。工具使用率在第一周后迅速下滑,变成了几个人在用的”小众工具”。

最后怎么解决:改变了推广策略,核心是”找到真正有痛的人,而不是推给所有人”。具体做法:先找3-5个日常文字工作最多的人,一对一帮他们把工具用起来,解决他们遇到的每一个具体问题。当这几个人开始真实受益(效率提升、减轻负担),他们会自然地向身边的人推荐。口碑传播的效果比全员通知强得多,而且来自身边同事的背书更有说服力。

另一个关键改变是做了一份”场景化使用指南”,不说”这个工具有哪些功能”,而是说”如果你经常要做XX,可以这样用”。场景越具体,用户越容易代入,上手意愿越强。

一年后的状态:现在怎么样了

踩完这些坑之后,工具现在的状态比当初预想的要好,但也比预想的要”克制”——它不是一个能做所有事的万能助手,而是把几件特定的事情做得足够稳、用户愿意长期用的日常工具。

真正高频在用的功能只有三四个,其他当初野心勃勃设计的功能,有一半在实际中没人用,最后悄悄下线了。这个结果反而是好事——功能少而精,维护成本低,用户体验也更清晰。

我们认为真正有价值的内部 AI 工具,不是那种”让人惊叹”的工具,而是那种”用完就忘了它在”的工具——用户不会感叹”AI 真厉害”,而是感觉”这件事比以前轻松了一点”。这种”轻松一点”,累积起来就是真实的效率提升。

上线前检查清单

基于这些踩坑经验,整理了一份内部工具上线前的检查清单,新项目对照着来:

| 阶段 | 检查项 |

|---|---|

| 需求阶段 | ✅ 明确了”给谁用、做什么、不做什么” |

| ✅ 找了至少3个潜在用户确认需求 | |

| ✅ 不同场景需求做了拆分,没有硬凑通用功能 | |

| Prompt 阶段 | ✅ 输出格式有明确要求(含示例) |

| ✅ Prompt 做了版本记录,存在可追溯的文档里 | |

| ✅ 用真实案例测试过至少10次,结果稳定 | |

| 安全阶段 | ✅ 告知用户哪些信息不能粘贴 |

| ✅ 对外发送的内容有人工审核环节 | |

| ✅ 敏感功能(HR/财务/客户数据)有权限控制 | |

| 上线阶段 | ✅ 有指定负责人,知道谁来维护和优化 |

| ✅ 有反馈收集机制(哪怕只是一个表情按钮) | |

| ✅ 先找有痛点的人一对一推广,不做广撒网通知 |

总结:哪些值得做,哪些不值得

回头看,最值得做的 Claude 内部工具是那些满足两个条件的场景:一是有明确的”输入 → 格式化输出”结构(不是开放式创作),二是被高频重复执行(每周至少做几次)。满足这两个条件的任务,用 Claude 工具化后收益最稳定、用户接受度最高。

相反,那些”偶尔用用”的功能、”每次需求都不一样”的任务、”需要大量行业专业判断”的工作,工具化之后往往变成鸡肋——做了大家不用,不做也没人想起来要。这类需求,直接教大家怎么在 claude.ai 里手动提问,往往比专门做一个工具性价比更高。

最后一句话总结这一年的经验:内部 AI 工具的价值不在于”用了多少 AI 技术”,而在于”真实地让多少人的某件事变得更轻松”。 从这个标准出发,会少做很多没用的东西,多做几件真正有用的。